Оптимизируйте свои Python-программы с новым изданием «High Performance Python». Это руководство предлагает практические рекомендации, которые помогут вам улучшить производительность кода без необходимости переписывать его с нуля. Авторы делятся конкретными техниками, которые позволят вам находить узкие места и эффективно их устранять.

Вы найдете инструменты для профилирования кода, которые позволят выявить части, требующие наибольших ресурсов. Каждая глава охватывает важные аспекты, начиная от оптимизации структуры данных и заканчивая лучшими практиками использования многопоточности и асинхронного программирования.

Используйте примеры из реальной жизни, чтобы мгновенно применять полученные знания. Вы сможете улучшить производительность своих программ, применяя предложенные подходы к существующим проектам. Такую практику можно смело назвать лучшим способом освоения материала.

Не упустите возможность скачать полную версию книги в формате PDF и получите доступ к ценной информации, которая сделает вашу работу с Python более продуктивной и целенаправленной.

Скачайте PDF: High Performance Python, 2-е Издание

Получите доступ к PDF-версии книги «High Performance Python, 2-е Издание». Этот ресурс откроет множество методов оптимизации ваших программ на Python. Книга включает практические примеры и техники, которые помогут вам повысить скорость выполнения кода и улучшить использование ресурсов.

- Скачивание PDF: Найдите ссылку для загрузки на официальном сайте или в специализированных магазинах электронных книг.

- Изучите основные темы: Книга охватывает такие аспекты, как оптимизация работы с памятью, использование многопоточности и асинхронного программирования.

- Реальные примеры: Авторы предоставляют практические советы и наглядные примеры, что позволяет применить изученное на практике.

- Современные библиотеки: Обратите внимание на использование таких инструментов, как NumPy и Cython для повышения производительности.

Не упустите шанс открыть для себя новые подходы к программированию на Python и сделайте свои приложения более быстрыми и отзывчивыми. Скачайте PDF и начните изучать уже сегодня!

Оптимизация скорости выполнения программ на Python

Используйте встроенные функции и библиотеки, чтобы ускорить выполнение кода. Например, функции из библиотеки NumPy обеспечивают высокую производительность при работе с массивами и матрицами. Операции, выполненные с использованием NumPy, выполняются на уровне C, что значительно снижает время выполнения по сравнению с обычными циклами на Python.

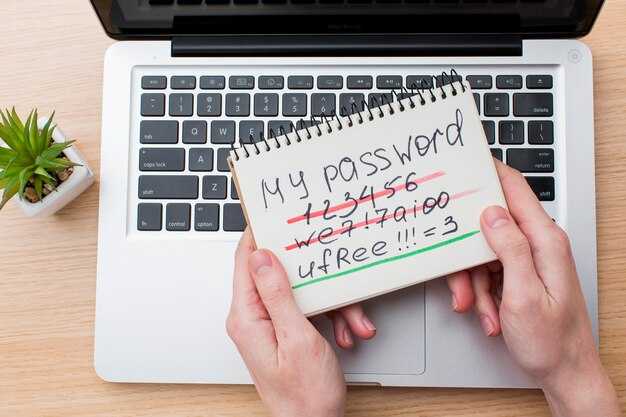

Избегайте использования глобальных переменных. Доступ к локальным переменным быстрее, чем к глобальным, так как Python использует разные механизмы для их хранения. Убедитесь, что ваши функции работают с локальными переменными, чтобы минимизировать время обращения к памяти.

Оптимизируйте циклы. Избегайте ненужных вычислений внутри циклов. Например, вынесите неизменяемые вычисления за пределы цикла. Также рассмотрите возможность использования генераторов, которые создают значения на лету, что экономит память и время.

Применяйте профилирование кода для выявления узких мест. Модули cProfile и line_profiler помогут вам понять, какие части кода требуют больше всего времени. Сфокусируйтесь на оптимизации этих участков.

| Метод | Описание | Преимущества |

|---|---|---|

| Использование NumPy | Работа с массивами на уровне C | Увеличение скорости обработки данных |

| Локальные переменные | Обработка данных внутри функций | Быстрый доступ к памяти |

| Генераторы | Создание значений на лету | Экономия памяти |

| Многопоточность | Параллельное выполнение I/O операций | Снижение времени ожидания ответа |

| Профилирование | Анализ производительности кода | Оптимизация узких мест |

Рассмотрите возможности использования JIT-компиляции с помощью Numba для ускорения функций, работающих с числовыми вычислениями. JIT-компилятор может значительно повысить производительность кода, минимизируя интерпретацию Python.

Проанализируйте использование структур данных. Эффективные структуры данных, такие как словари и множества, обеспечивают быстрый доступ и манипуляции с данными. Если возможно, выбирайте их вместо списков для уменьшения затрат на время выполнения.

Сокращайте количество вызовов функций. Каждый вызов функции требует накладных расходов, поэтому объединение действий в менее частые вызовы может ускорить выполнение программы.

Как улучшить производительность циклов и итераций

Используй встроенные функции и методы, такие как `map()`, `filter()`, и списковые включения. Эти инструменты часто работают быстрее, чем традиционные циклы `for`, так как они оптимизированы на уровне реализации.

Сократи число обращений к элементам при работе с большими последовательностями. Вместо повторного доступа к элементам в цикле, сохраняй значения во временные переменные.

Если это возможно, минимизируй количество операций внутри цикла. Перемести операции, которые не зависят от текущего значения итерации, за пределы цикла. Это может включать вычисления, которые не меняются от итерации к итерации.

При работе с большими массивами данных рассмотрите использование библиотеки NumPy. Она оптимизирована для работы с векторами и матрицами, значительно ускоряя операции по сравнению с обычными списками Python.

Включай только те операции, которые действительно необходимы. Например, использование конструкции `break` может помочь избежать лишних итераций, когда условие уже выполнено.

Обратите внимание на процессорные кэши. Если работаешь с данными, хранящимися в одном месте памяти, старайся группировать доступ к ним, чтобы уменьшить задержки.

Экспериментируй с различными алгоритмами. Некоторые алгоритмы могут потребовать меньше итераций для достижения результата. Проводи профилирование, чтобы выявить узкие места.

Рассматривай возможность использования параллелизма для разделения вычислений по нескольким потокам или процессам. Библиотека `concurrent.futures` позволяет легко создавать асинхронные задачи, которые распределяют нагрузку. Это особенно полезно при выполнении вычислительно сложных операций.

Оптимизируй структуру данных, которую используешь для хранения информации. Списки могут быть менее производительными, чем множества или словари для определенных задач, так как содержат специфические механизм доступа.

Следи за потреблением памяти при итерациях. Слишком большие структуры данных могут замедлить выполнение программы из-за управления памятью. Выбирай наиболее подходящие типы данных.

Использование встроенных функций для ускорения обработки данных

Используйте встроенные функции Python, чтобы значительно ускорить обработку данных. Они реализованы на уровне, близком к машинному, что обеспечивает отличную производительность.

Вот несколько рекомендаций по их применению:

- Функция

map: Применяйте ее для применения функции к элементам последовательности. Это экономит время на написание циклов: - Функция

filter: Используйте для выборки значений, соответствующих заданному критерию. Она сильно сокращает количество строк кода: - Функция

reduce: Применяйте для последовательного выполнения операции над элементами последовательности. Это полезно для агрегирования данных: - Списковые включения: Используйте их для создания списков более «читаемым» способом. Списковые включения часто работают быстрее, чем функция

map: - Функция

zip: Используйте для объединения нескольких списков в кортежи. Это удобно и эффективно:

result = list(map(lambda x: x * 2, my_list))

filtered = list(filter(lambda x: x > 10, my_list))

from functools import reduce

total = reduce(lambda a, b: a + b, my_list)

squared = [x * x for x in my_list]

combined = list(zip(list1, list2))

Попробуйте применять эти функции, чтобы сократить время выполнения и упростить код. Каждый из этих инструментов поможет преобразовать вашу работу с данными в более лаконичную и быструю задачу. Это позволит вам сосредоточиться на логике программы, а не на её реализации.

Когда стоит применять многопоточность и асинхронность

Применяйте многопоточность, когда ваша программа выполняет задачи, требующие параллельной обработки. Это актуально для CPU-нагруженных операций, таких как обработка больших массивов данных или вычисления. Благодаря распределению ресурсов, вы существенно ускорите выполнение. Например, запуск нескольких потоков при анализе данных или обработке изображений позволяет использовать мощности процессора более рационально.

Если ваши задачи требуют значительных вычислительных операций, но не зависят от друг от друга, тогда выбирайте многопоточность. В случае, когда операции требуют доступ к общим ресурсам или сильно зависят друг от друга, асинхронность поможет избежать конфликтов и упростит управление состоянием. Выбор между этими двумя подходами зависит от характера вашей задачи и требований к производительности.

Иногда целесообразно комбинировать оба подхода: использовать асинхронные вызовы для взаимодействия с сетью и многопоточные операции для тяжёлых вычислений. Это даст вам гибкость и позволяет оптимально использовать ресурсы. Вносите изменения в зависимости от характера задач, чтобы достичь наилучших результатов.

Повышение использования памяти в Python приложениях

Используйте генераторы вместо списков, когда это возможно. Генераторы создают элементы по одному и занимают значительно меньше памяти по сравнению со стандартными списками. Это особенно полезно при обработке больших наборов данных.

Применяйте `__slots__` в определениях классов. Это устраняет динамическое создание атрибутов, что ведет к меньшему использованию памяти для объектов класса, особенно если у вас много экземпляров.

Анализируйте утечки памяти с помощью `tracemalloc`. Этот модуль позволяет отслеживать выделение памяти и выявлять участки, которые используют ее значительно больше, чем нужно.

Используйте `del` для освобождения памяти. Если переменные больше не нужны, явно удаляйте их, особенно когда они занимают много места. Это может помочь снизить общий объем занятой памяти.

Размежуйте данные на небольшие, независимые куски. Вместо хранения большого объема данных в одном месте, разложите их по отдельным элементам, которые можно загружать по мере необходимости.

Применяйте стандартные библиотеки, такие как `array` и `collections.deque`, которые могут быть более оптимизированы по сравнению со стандартными типами данных. Это может улучшить производительность и снизить использование памяти.

Используйте инструменты анализа памяти, такие как `memory_profiler`. Это поможет вам понять, где происходят проблемы, и поможет в принятии решений по оптимизации программ.

Обратите внимание на использование кэширования. Такого рода подходы могут сократить необходимость в повторном вычислении данных и, следовательно, сократить затраты памяти.

Избегайте хранения больших объектов в глобальных переменных. Это может привести к их неожиданному росту. Сохраняйте состояние в модулях или классах и используйте локальные переменные.

Наконец, оптимизируйте использование библиотек. Убедитесь, что вы ориентируетесь на библиотеки, созданные для производительности и низкого потребления памяти, так как это может оказать значительное влияние на все приложение.

Оптимизация работы со списками и словарями

Используйте списковые включения. Они позволяют создавать новые списки более лаконичным и быстрым способом. Например, чтобы получить удвоенные значения из исходного списка, используйте следующую конструкцию:

result = [x * 2 for x in original_list]Этот метод не только более читабельный, но и быстрее, чем использование цикла for.

Избегайте дублирования данных. Часто списки содержат повторяющиеся элементы. Используйте sets для удаления дубликатов, когда порядок элементов не важен:

unique_values = list(set(original_list))Для работы со словарями используйте метод get. Он позволяет избежать возникновения KeyError, если ключ не найден. Например:

value = my_dict.get(key, default_value)Оптимизируйте доступ к элементам словаря. Если вы часто проверяете наличие ключа, используйте оператор in:

if key in my_dict:Это уменьшает количество лишних обращений к словарю.

Храните данные в подходящей структуре. Если вам нужно часто сортировать, используйте collections.defaultdict или OrderedDict. Также рассмотрите использование Counter для частотного анализа элементов:

from collections import Counter

counter = Counter(original_list)Предпочитайте генераторы. Они позволяют экономить память, так как создают элементы по одному. Например, в случае обработки большого объема данных:

(x * 2 for x in original_list)Изучите библиотеку NumPy. Она предоставляет эффективные методы работы с массивами, что может существенно повысить производительность, особенно для численных данных:

import numpy as np

array = np.array(original_list)Используйте модуль itertools. Он предлагает эффективные итераторы, которые могут значительно уменьшить время выполнения сложных операций над списками. Например, чтобы создавать комбинации:

from itertools import combinations

combs = combinations(original_list, 2)Опираясь на эти рекомендации, вы сможете улучшить свои программы, повысив производительность и упростив код.

Секреты работы с генераторами и итераторами

Исключите излишние нагрузки на память с помощью генераторов. Используйте их для обработки больших наборов данных, создавая элементы по одному, а не загружая всю последовательность целиком. Например, объявление генератора с помощью выражения (x * x for x in range(10)) позволяет вам использовать его как итератор, не создавая массив из 10 элементов одновременно.

Воспользуйтесь функцией yield для создания собственных генераторов. Это позволяет вам возвращать значения по одному, при этом сохранять состояние функции. Подумайте о генераторе для вычисления чисел Фибоначчи: при каждом вызове он будет возвращать следующую пару чисел, не теряя информацию о предыдущих.

Мастерство использования итераторов заключается в их совместимости с другими инструментами Python. Используйте функции map(), filter() и zip() с генераторами для обработки данных. Например, filter(str.isdigit, some_string) можно объединить с генератором, чтобы выделить только числовые символы.

Оптимизируйте ваши циклы, применяя генераторы и итераторы минимально необходимое количество раз. Избегайте многократных проходов по одной и той же последовательности. Вместо создания нескольких списков на каждом шаге, используйте itertools.chain() для объединения нескольких генераторов в один поток данных.

Рассмотрите возможность использования itertools.combinations() для работы с перебором элементов. Это значительно упрощает процесс генерации комбинаций, помогая сохранять чистоту кода и избегать избыточных вычислений.

Наконец, учитесь читать и понимать документацию по стандартным библиотекам и модулям, связанным с итераторами и генераторами. Это расширит ваши горизонты и даст новые идеи для применения этих мощных инструментов в ваших проектах.

Технологии управления памятью и рассмотрение сборщика мусора

Перед использованием Python детально изучите, как управление памятью влияет на производительность. В Python сборщик мусора (GC) отвечает за автоматическое освобождение ненужных объектов. Он работоспособен благодаря механизму отслеживания ссылок и, при необходимости, проводит циклы сборки.

Оптимизируйте использование памяти, включив механизм «более старших поколений» в сборщике мусора. Он разделяет объекты на три поколения: молодое, среднее и старое. Молодые объекты проверяются чаще, что уменьшает нагрузку на систему, а старые объекты проверяются реже, поскольку они менее подвержены очищению.

Изучите использование конкретных библиотек, таких как `gc`, для настройки параметров сборщика. Например, `gc.set_debug(gc.DEBUG_LEAK)` позволяет выявить утечки памяти. Чтобы уменьшить потребление, используйте менеджеры контекста. Они автоматически высвобождают ресурсы после завершения работы с ними. Например, `with open(‘file.txt’) as file:` эффективно освобождает память, связанная с файлом.

Не забывайте о структурировании данных. Используйте кортежи вместо списков, когда возможно. Это экономит память, так как кортежи имеют меньший размер. Встроенные контейнеры также обеспечивают большую производительность, чем пользовательские. Сложные структуры данных, такие как `deque` из модуля `collections`, могут значительно повысить скорость обработки.

Обратите внимание на библиотеки, такие как NumPy, которые оптимизируют работу с массивами и матрицами. Они используют непрерывные блоки памяти, что позволяет сократить время доступа и увеличивает общую производительность приложения. Также рассмотрите использование `cython` для компиляции критически важных участков кода, где требуется высокая скорость выполнения.

Сочетание всех этих стратегий приведет к значительному улучшению работы вашего кода и управлению памятью в Python. Не забывайте периодически анализировать использование памяти с помощью инструментов, таких как `memory-profiler`, для выявления узких мест и дальнейшей оптимизации.

Профилирование и анализ расхода памяти

Используйте модуль memory_profiler для получения подробной информации о потреблении памяти вашего кода. Установите его с помощью команды pip install memory-profiler. Затем добавьте декоратор @profile к функциям, которые хотите анализировать. Запустите ваш сценарий с флагом -m memory_profiler, чтобы увидеть поля расхода памяти.

Также рассмотрите использование tracemalloc, который входит в стандартную библиотеку Python. Он позволяет отслеживать выделение памяти и выявлять утечки. В начале вашего скрипта добавьте import tracemalloc и вызовите tracemalloc.start(), чтобы активировать мониторинг. Используйте tracemalloc.take_snapshot() для получения снимка памяти, а затем сравните его с предыдущими снимками, чтобы проанализировать изменения.

Для более детального анализа выделяемой памяти используйте objgraph. Установите его через pip install objgraph, чтобы визуализировать объекты в памяти. objgraph.show_most_common_types() предоставляет информацию о типах объектов, занимающих наибольшее количество памяти.

Оптимизируйте позиции кода с помощью профилирования, чтобы минимизировать пиковые нагрузки. Разделяйте тяжелые процессы на более мелкие части, чтобы избежать одновременного использования значительных объемов памяти. Внедрите аналитику в код, добавляя временные метрики для ключевых операций, чтобы выявить узкие места.

Не забывайте тестировать изменения. Используйте регулярные проверки метрик памяти, чтобы отслеживать эффективность изменений. Это поможет вам выявить, как оптимизации влияют на использование ресурсов вашего приложения, и куда следует направить дальнейшие усилия. Записывайте результаты для сравнительного анализа производительности перед и после внесенных изменений.